Czym jest system AI w rozumieniu AI Act?

W tym artykule dowiesz się:

- jak AI Act definiuje system AI (art. 3 pkt 1),

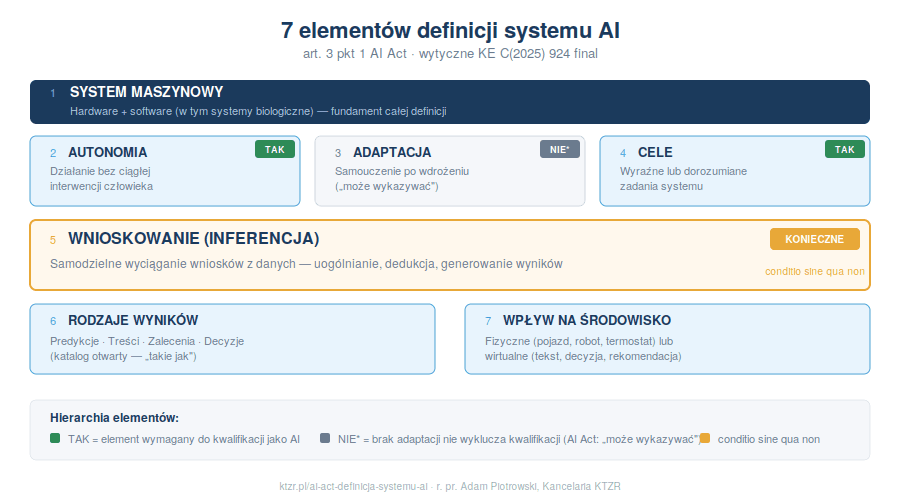

- jakie 7 elementów wyróżnia Komisja Europejska w definicji systemu AI,

- czym jest autonomia, adaptacja, cele, wnioskowanie i wpływ na środowisko,

- dlaczego wnioskowanie (inferencja) jest warunkiem sine qua non kwalifikacji jako AI,

- jak w praktyce przeprowadzić kwalifikację — z autorskim testem i konkretnymi przykładami.

Spis treści:

- Definicja systemu AI w AI Act (art. 3 pkt 1)

- Element 1: System maszynowy

- Element 2: Działanie z różnym poziomem autonomii

- Element 3: Zdolność adaptacji po wdrożeniu

- Element 4: Wyraźne lub dorozumiane cele

- Element 5: Wnioskowanie — kluczowy warunek kwalifikacji

- Element 6: Rodzaje wyników

- Element 7: Wpływ na środowisko fizyczne lub wirtualne

- Co nie jest systemem AI — katalog wyłączeń

- Test kwalifikacyjny — czy Twoje rozwiązanie to system AI?

- FAQ

Pytanie brzmi prosto, ale odpowiedź bywa trudna. Granica między „zwykłym oprogramowaniem” a „systemem AI” nie jest ostra. Pomylisz się w jedną stronę — obciążysz firmę niepotrzebnym compliance. Pomylisz się w drugą — naruszysz AI Act z karami do 35 mln EUR.

Dnia 6 lutego 2025 r. Komisja Europejska opublikowała wytyczne dotyczące definicji systemu AI (dwa dni po wytycznych dotyczących zakazanych praktyk z art. 5, opublikowanych 4 lutego 2025 r.). Poniżej omawiam każdy element definicji w oparciu o te wytyczne, orzecznictwo TSUE i literaturę.

Ogólne wprowadzenie do AI Act — co to jest, harmonogram wdrożenia, kategorie ryzyka, kary — znajdziesz w artykule AI Act — co musisz wiedzieć o regulacji sztucznej inteligencji w UE. Pamiętaj, że część przepisów AI Act już obowiązuje: zakazy praktyk AI i obowiązki z zakresu AI literacy od 2 lutego 2025 r., a przepisy dotyczące zarządzania i obowiązki dostawców modeli GPAI od 2 sierpnia 2025 r.

Potrzebujesz pomocy przy kwalifikacji systemu AI?

Kancelaria KTZR specjalizuje się w prawie nowych technologii i AI. Pomagamy firmom IT ustalić, czy ich rozwiązania podlegają AI Act — i jakie obowiązki z tego wynikają.

Umów konsultację →Definicja systemu AI w AI Act (art. 3 pkt 1) — 7 elementów

System AI został w art. 3 pkt 1 AI Act zdefiniowany jako system maszynowy:

Definicja jest celowo szeroka. Ustawodawca zrezygnował z zamkniętego katalogu technik AI i postawił na elementy ogólne — tak, żeby rozporządzenie nie zdezaktualizowało się z każdą nową generacją modeli. Zgodnie z motywem 97 preambuły AI Act, modele AI ogólnego przeznaczenia mogą być wprowadzane do obrotu na różne sposoby — przez biblioteki, API, bezpośrednie pobieranie lub w wersji fizycznej.

Wytyczne Komisji Europejskiej wyróżniają w definicji siedem elementów, opierając analizę na perspektywie cyklu życia obejmującej fazę przedwdrożeniową (budowania) oraz fazę po wdrożeniu (użytkowania):

| Nr | Element definicji | Opis | Wymagany? |

|---|---|---|---|

| 1 | System maszynowy | Fundament techniczny — hardware + software | Tak |

| 2 | Różny poziom autonomii | Zdolność do działania bez ciągłej interwencji człowieka (po wdrożeniu) | Tak |

| 3 | Zdolność adaptacji | Samouczenie się i zmiana zachowania po wdrożeniu | Nie — brak adaptacji nie wyklucza kwalifikacji jako AI |

| 4 | Wyraźne lub dorozumiane cele | Zadania, do których system jest przeznaczony | Tak |

| 5 | Wnioskowanie (inferencja) | Samodzielne wyciąganie wniosków z danych | Tak — conditio sine qua non |

| 6 | Rodzaje wyników | Predykcje, treści, zalecenia, decyzje | Tak |

| 7 | Wpływ na środowisko | Zmiana stanu fizycznego lub wirtualnego otoczenia | Tak |

Element 1: System maszynowy — co to właściwie znaczy?

AI Act nie definiuje wprost, czym jest „system maszynowy”. W literaturze wskazuje się, że powinien być rozumiany przynajmniej jako układ modeli — pojęcie ogólniejsze od pojęcia komputera. W obecnej definicji system sztucznej inteligencji nie jest już „oprogramowaniem” — i słusznie, bo współczesne systemy AI to nie tylko software.

Pojęcie maszyny zostało zdefiniowane w Rozporządzeniu (UE) 2023/1230 (art. 3 ust. 1 lit. a) jako:

Ta definicja odnosi się raczej do maszyn w rozumieniu przemysłowym i nie oddaje istoty maszyny w rozumieniu AI Act.

Komisja Europejska w wytycznych precyzuje, że pod pojęciem „systemu maszynowego” można rozumieć:

- komponenty sprzętowe — procesory, pamięć, urządzenia sieciowe, interfejsy wejścia/wyjścia,

- składniki oprogramowania — kod, instrukcje, systemy operacyjne, aplikacje.

Wytyczne KE wskazują też, że „systemem maszynowym” może być system biologiczny lub organiczny — o ile zapewnia moc obliczeniową. W praktyce ma to marginalne znaczenie, ale pokazuje, jak szeroko KE interpretuje to pojęcie.

W mojej ocenie pojęcie systemu maszynowego zawiera dwa elementy:

Aspekt fizyczny — komponenty sprzętowe, bez których sztuczna inteligencja nie może funkcjonować (serwery, GPU, infrastruktura sieciowa — a teoretycznie także systemy biologiczne zapewniające moc obliczeniową).

Aspekt techniczny/funkcjonalny — warstwa informatyczna: języki programowania, instrukcje systemowe, frameworki, modele.

W praktyce najbezpieczniej jest przyjmować, że każde rozwiązanie powiązane z AI ma charakter systemu maszynowego. Przy dzisiejszych rozwiązaniach trudno wyobrazić sobie sytuację, w której system AI nie zostałby za taki uznany — dotyczy to w szczególności wszystkich dużych modeli językowych (LLM).

Element 2: Działanie z różnym poziomem autonomii

W literaturze proponuje się, aby pojęcie „działania z różnym poziomem autonomii” rozumieć jako możliwość wykonywania zadań o różnym stopniu skomplikowania bez bezpośredniej interwencji człowieka.

Potwierdza to motyw 12 preambuły AI Act: systemy AI „są w pewnym stopniu niezależne od zaangażowania ze strony człowieka i zdolne do działania bez interwencji człowieka”.

Słownikowo autonomię rozumie się jako: „niezależność przejawiającą się w decydowaniu o sobie i rządzeniu się własnymi prawami”.

W kontekście „autonomii programu” warto zwrócić uwagę na orzeczenie TSUE w sprawie C-634/21 (profilowanie danych klienta przy scoringu kredytowym). TSUE uznał, że również gdy ostateczną decyzję programu zatwierdza człowiek, ale większość pracy wykonuje program — można mówić o znacznej autonomii.

Komisja Europejska podkreśla, że autonomia systemów AI idzie w parze z umiejętnością wnioskowania — bez pewnego poziomu autonomii ten proces nie byłby możliwy.

Przy ocenie autonomii liczy się zaangażowanie człowieka: o pełnej autonomii nie można mówić, gdy finalny efekt zależy od działania ludzkiego.

Definicja systemu AI nie wymaga jednak pełnej autonomii — odnosi się do „różnego stopnia autonomii”. Momentem granicznym jest ustalenie, czy system może działać w ogóle bez udziału człowieka. Jeśli tak — spełnia ten element.

Praktyczne przykłady

System o pewnym stopniu autonomii (AI): System oceny kandydatów, który działa na podstawie danych wprowadzonych przez człowieka, ale daje wynik w oparciu o wyuczone kryteria.

System o dużym stopniu autonomii (AI): Narzędzia do „vibe codingu”, które na podstawie instrukcji użytkownika samodzielnie tworzą aplikacje. Popularne IDE z AI (np. Codex) — użytkownik działa jako „reżyser”.

Brak autonomii (nie AI): Prosty skrypt w Pythonie zmieniający rozszerzenie pliku z .xls na .csv. System alertów w banku flagujący przelewy powyżej 15 000 EUR na podstawie sztywnego progu.

W praktyce: jeżeli występują wątpliwości co do tego, czy system ma jakikolwiek poziom autonomii, bezpieczniej jest przyjąć, że go posiada.

Element 3: Zdolność adaptacji po wdrożeniu

Zgodnie z motywem 12 preambuły AI Act:

Adaptacja sprowadza się do umiejętności uczenia się — wyciągania wniosków i dostosowywania się do zmiennych warunków. W literaturze wskazuje się, że zdolności adaptacyjnych nie posiadają „klasyczne” deterministyczne modele działające w oparciu o z góry założone, niezmienne instrukcje.

W wytycznych KE podkreślono, że autonomia i zdolność adaptacji to dwa odrębne, ale ściśle powiązane pojęcia. Pytanie brzmi: czy nowe zachowania systemu po adaptacji mogą przynieść inne wyniki niż poprzednie na bazie tych samych danych wejściowych?

Kiedy dochodzi do adaptacji?

Aktualizacja parametrów (Online/Continuous Learning): system w trakcie działania na rynku zmienia swoje wewnętrzne wagi lub architekturę na podstawie nowych danych.

Ewolucja zachowania: to samo zapytanie zadane w styczniu może dać inny wynik w grudniu — nie dlatego, że zmienił się kontekst, ale dlatego, że model przebudował wiedzę na podstawie interakcji.

Co nie jest adaptacją?

Jeśli chatbot pamięta historię konwersacji w ramach jednej sesji (okno kontekstowe) i na tej podstawie dopasowuje odpowiedzi — to nie jest adaptacja.

Adaptacja następuje dopiero wtedy, gdy konwersacja zostanie użyta do dotrenowania modelu „w locie”, tak aby trwale zmienił sposób odpowiadania innym użytkownikom.

Przykłady

System bez adaptacji („model zamrożony” — wciąż AI): System medyczny analizujący zdjęcia RTG. Wytrenowany na milionach zdjęć, certyfikowany i wdrożony w szpitalu. Wagi są stałe — nie uczy się na nowych zdjęciach.

System z adaptacją: Algorytm antyfraudowy w banku, który na bieżąco analizuje nowe wzorce oszustw i aktualizuje swój model w czasie rzeczywistym.

Element 4: Wyraźne lub dorozumiane cele

Ten element bywa pomijany, ale wytyczne KE wyodrębniają go jako samodzielny składnik definicji. Art. 3 pkt 1 stanowi, że system AI wnioskuje „na potrzeby wyraźnych lub dorozumianych celów„.

Cele to zadania, do których wykonania przeznaczony jest system AI. Wytyczne KE rozróżniają przy tym dwa pojęcia:

Cele systemu (wewnętrzne) — wynikają z konstrukcji i treningu modelu. Np. model językowy „ma na celu” generowanie tekstu spójnego z promptem; system rekomendacyjny „ma na celu” dopasowanie treści do profilu użytkownika.

Zamierzone przeznaczenie (external intended purpose) — wynika z kontekstu wdrożenia i dokumentacji dostawcy. To przeznaczenie jest istotne przy klasyfikacji ryzyka (art. 6 AI Act).

Cele mogą być:

- wyraźne — zdefiniowane wprost w specyfikacji systemu, np. „klasyfikuj zdjęcia RTG pod kątem obecności zmian nowotworowych”,

- dorozumiane — model GPAI nie ma jednego z góry określonego celu, ale jest zdolny do realizacji różnorodnych zadań. Cel wynika z kontekstu użycia przez deployer’a.

AI Act obejmuje oba rodzaje celów. System może realizować cele, o których jego twórca wprost nie wspomniał, ale które wynikają z architektury i możliwości systemu.

Element 5: Wnioskowanie — kluczowy, niezbędny warunek kwalifikacji

Motyw 12 preambuły AI Act wskazuje zdolność do wnioskowania jako jedną z cech wyróżniających systemy AI.

Wnioskowanie to — w dużym uproszczeniu — zdolność systemu do generowania wyników (predykcji, treści, zaleceń, decyzji) na podstawie danych wejściowych. Wyniki nie mogą powstawać „z niczego” — muszą wynikać z przetworzenia danych.

Wytyczne KE precyzują, że wyrażenie „wnioskuje, jak” ma szerszy zakres niż wąskie rozumienie inferencji. Sformułowanie „wnioskuje, jak generować wyniki” odnosi się do etapu tworzenia, na którym system uzyskuje wyniki za pomocą technik AI umożliwiających wnioskowanie.

Techniki uczenia maszynowego

W wytycznych Komisja wymienia kilka technik:

Uczenie nadzorowane — system uczy się na oznakowanych danych, gdzie dane wejściowe są sparowane z prawidłowym wynikiem. Przykład: system wykrywania spamu uczący się na zbiorze wiadomości oznaczonych jako „spam” i „nie-spam”.

Uczenie nienadzorowane — system uczy się na danych bez etykiet. Przykład: system wykorzystywany przez firmy farmaceutyczne do odkrywania leków, grupujący związki chemiczne.

Uczenie samonadzorowane — podkategoria uczenia nienadzorowanego, system tworzy własne etykiety z danych. Przykład: system rozpoznawania obrazów uczący się przez przewidywanie brakujących pikseli.

Uczenie przez wzmacnianie — system uczy się w drodze prób i błędów. Przykład: ramię robota chwytające przedmioty.

Uczenie głębokie — podkategoria uczenia maszynowego wykorzystująca sieci neuronowe.

Druga kategoria to podejście oparte na logice i wiedzy — wnioskowanie na podstawie zakodowanej wiedzy lub symbolicznego przedstawienia zadania. Systemy uczą się na faktach przekazanych przez ekspertów i za pomocą silników dedukcyjnych dokonują „rozumowania” nowych informacji. Przykład: system AI oparty o wiedzę prawniczą z zebranych orzeczeń, wskazujący możliwy wynik sprawy sądowej.

Zwykłe oprogramowanie vs system AI — na czym polega różnica?

| Tradycyjne oprogramowanie | System AI | |

|---|---|---|

| Formuła | Dane + Reguły (człowiek) = Wynik | Dane + Pożądany Wynik = Model sam tworzy reguły |

| Etap działania | Zawsze te same reguły → przewidywalny wynik | Nowe Dane + Wyuczony Model = System generuje wynik |

| Reguły | Stworzone i zakodowane przez programistę | Wyuczone przez model na podstawie danych |

| Przykład | „Jeśli zarobki > 5000 PLN → przyznaj kredyt” | System wykrywa ukryte korelacje w tysiącach historycznych spłat |

Różnice na przykładach

Filtr antyspamowy w poczcie e-mail

Zwykłe przetwarzanie (brak AI): Program ma wpisaną regułę: „Jeśli tytuł zawiera słowo 'promocja’ LUB 'książę z Nigerii’ → przenieś do SPAM.” To zwykła logika if-then.

Wnioskowanie (system AI): System przeanalizował miliony wiadomości oznaczonych jako spam. Dostaje nową wiadomość bez zakazanych słów z czarnej listy. Analizuje nietypową strukturę zdań, porę wysyłki, ścieżkę serwerów — i wnioskuje, że na 98% to spam. Programista nigdy nie zaprogramował reguły na tę kombinację cech.

Scoring kredytowy

Zwykłe przetwarzanie (brak AI): Bank ma algorytm: „Zarobki > 5000 PLN ORAZ brak długów → przyznaj kredyt.”

Wnioskowanie (system AI): System przeanalizował tysiące historycznych spłat. Wnioskuje, że klient ma wysokie ryzyko niespłacenia, ponieważ jego profil zachowań pasuje do ukrytego wzorca prowadzącego do niewypłacalności. Odrzuca wniosek na podstawie odnalezionych korelacji, nie twardych progów. Tego typu system to w rozumieniu AI Act system high-risk (Załącznik III — scoring kredytowy).

Element 6: Rodzaje wyników

Art. 3 pkt 1 wymienia cztery kategorie wyników, które może generować system AI:

- Predykcje — np. prognoza pogody, scoring kredytowy, przewidywanie awarii maszyn.

- Treści — np. teksty generowane przez modele językowe, obrazy z generatorów grafik, kod źródłowy.

- Zalecenia — np. rekomendacje filmów, sugestie diagnostyczne w medycynie, propozycje tras w nawigacji.

- Decyzje — np. automatyczne zablokowanie transakcji, odrzucenie wniosku kredytowego, preselekcja CV.

Katalog nie jest zamknięty — ustawodawca użył sformułowania „takie jak”.

Element 7: Wpływ na środowisko fizyczne lub wirtualne

To najszersza z przesłanek. Wytyczne KE wskazują, że ma ona podkreślać fakt, iż systemy AI nie są pasywne — wchodzą w interakcję z otoczeniem, pobierają dane (input) i generują wyniki (output), które aktywnie zmieniają stan otoczenia.

Zgodnie z motywem 12 preambuły AI Act, pojęcie „środowiska” oznacza po prostu „konteksty, w których działają systemy AI”. Wyniki mogą modyfikować te konteksty na dwa sposoby:

Wpływ na sferę fizyczną — wynik działania systemu przekłada się na realną zmianę w świecie materialnym:

- autonomiczny pojazd zmieniający tor jazdy,

- robot przemysłowy sortujący paczki,

- inteligentny termostat zmieniający temperaturę,

- system irygacyjny optymalizujący zużycie wody.

Wpływ na sferę wirtualną — wygenerowany wynik zmienia cyfrowy stan rzeczywistości:

- model językowy generujący tekst na ekranie użytkownika,

- system antyfraudowy blokujący transakcję,

- spersonalizowana rekomendacja filmu,

- dynamic pricing w sklepie internetowym.

Wpływ na środowisko nie musi być bezpośredni. System AI generujący jedynie „zalecenie” (np. sugestia diagnostyczna dla lekarza) wciąż wpływa na środowisko, ponieważ kształtuje działanie podjęte przez człowieka.

Co nie jest systemem AI — katalog wyłączeń z wytycznych KE

Wytyczne Komisji Europejskiej explicite wyłączają spod definicji systemu AI następujące kategorie:

- Narzędzia optymalizacji matematycznej — regresja liniowa, tradycyjne modele fizyczne, programowanie liniowe.

- Podstawowe narzędzia do przetwarzania danych — arkusze kalkulacyjne (Excel), zapytania SQL, klasyczne bazy danych.

- Klasyczne heurystyki — np. algorytm minimax w szachach, algorytmy sortowania, proste systemy reguł.

- Proste systemy predykcji — oparte na podstawowych regułach statystycznych, niewyciągające wniosków z danych.

- Podstawowe operacje przetwarzania — pattern matching (Ctrl+F), filtrowanie i sortowanie bazy danych, tradycyjne operacje matematyczne (np. wyliczenie średniej).

Łączy je jedno: brak zdolności do wnioskowania (inferencji) w rozumieniu AI Act. Działają wyłącznie na zasadzie „Dane + Reguły stworzone przez człowieka = Wynik”, bez samodzielnego wyciągania wniosków.

Porównanie: system AI vs zwykłe oprogramowanie

| Rozwiązanie | System AI? | Dlaczego? |

|---|---|---|

| ChatGPT, Claude, Gemini | Tak | LLM — wnioskowanie, autonomia, wpływ na środowisko wirtualne |

| System preselekcji CV oparty na ML | Tak | Wnioskowanie z danych, autonomia, wpływ na decyzje HR (high-risk, Załącznik III) |

| Algorytm antyfraudowy w banku (ML) | Tak | Wnioskowanie z wzorców transakcji, adaptacja w czasie rzeczywistym |

| System rekomendacji filmów | Tak | Wnioskowanie z preferencji użytkownika, wpływ na środowisko wirtualne |

| Autonomiczny pojazd | Tak | Pełna autonomia, wnioskowanie, wpływ fizyczny |

| Codex / Cursor / IDE z AI | Tak | Duża autonomia, generowanie kodu (wnioskowanie), wpływ na pliki lokalne |

| Arkusz Excel z formułami | Nie | Brak wnioskowania — deterministyczne reguły stworzone przez człowieka |

| Zapytanie SQL do bazy danych | Nie | Filtrowanie i sortowanie — brak inferencji |

| Skrypt Python zmieniający format pliku | Nie | Brak autonomii i wnioskowania — sztywne instrukcje |

| Alert bankowy: przelew > 15 000 EUR | Nie | Prosty próg if-then — brak wnioskowania |

| Algorytm minimax w szachach | Nie | Klasyczna heurystyka — explicite wyłączony przez wytyczne KE |

| Regresja liniowa | Nie | Tradycyjna optymalizacja matematyczna — wyłączona przez wytyczne KE |

Szczegółowe omówienie obowiązków dla systemów AI (w tym kategorii ryzyka i harmonogramu wdrożenia) oraz kwestii kontraktowych (umowa wdrożeniowa IT a AI Act) znajdziesz w pozostałych artykułach z tej serii.

Test kwalifikacyjny — czy Twoje rozwiązanie to system AI?

Jak widać, definicja systemu AI w AI Act jest szeroka. Ocena, czy dane rozwiązanie mieści się w tym pojęciu, wymaga analizy konkretnego przypadku. Poniższy schemat pozwala jednak na wstępną kwalifikację.

| Krok | Pytanie | NIE → | TAK → |

|---|---|---|---|

| 1. Autonomia | Czy system działa z jakimkolwiek poziomem autonomii po wyznaczeniu mu celu? | Zwykłe oprogramowanie — koniec testu | → Krok 2 |

| 2. Inferencja ⚠️ | Czy system samodzielnie wyciąga wnioski z danych (uogólnia, dedukuje, generuje)? | Tradycyjny system informatyczny — koniec testu | → Krok 3 |

| 3. Wpływ | Czy wynik oddziałuje na środowisko fizyczne lub wirtualne? | Pasywny model badawczy — co do zasady poza AI Act | → System AI w rozumieniu AI Act |

| 4. Adaptacja | Czy system zmienia się (uczy) po wdrożeniu? | Zamrożony system AI — parametry stałe | Adaptacyjny system AI — wymaga szczególnego monitorowania |

Krok 2 (inferencja) jest najważniejszy. Wytyczne KE uznają zdolność do wnioskowania za niezbędny warunek kwalifikacji jako system AI. Odpowiedź „NIE” na którymkolwiek z kroków 1–3 oznacza, że rozwiązanie z dużym prawdopodobieństwem nie podlega AI Act.

Jeżeli test wskazuje, że Twoje rozwiązanie to system AI — kolejny krok to klasyfikacja ryzyka (zakazane praktyki / high-risk / ograniczone ryzyko / minimalne ryzyko). Jeśli budujesz system AI na zlecenie klienta — sprawdź, jak umowa wdrożeniowa IT powinna rozdzielać obowiązki compliance.

FAQ — definicja systemu AI w AI Act

Czym jest system AI w rozumieniu AI Act?

Zgodnie z art. 3 pkt 1 AI Act, system AI to system maszynowy spełniający 7 elementów wyróżnionych przez Komisję Europejską: system oparty na maszynie, autonomia, zdolność adaptacji, cele (wyraźne lub dorozumiane), wnioskowanie, generowanie wyników i wpływ na środowisko. Kluczowym elementem odróżniającym AI od zwykłego oprogramowania jest wnioskowanie (inferencja).

Czy prosty skrypt lub makro w Excelu to system AI?

Co do zasady nie. Wytyczne KE explicite wyłączają podstawowe narzędzia do przetwarzania danych, arkusze kalkulacyjne i tradycyjne operacje matematyczne spod definicji systemu AI. Brakuje im zdolności do wnioskowania.

Czy chatbot oparty na drzewie decyzyjnym to system AI?

Jeśli chatbot działa wyłącznie na z góry zaprogramowanych regułach if-then — nie spełnia kluczowej przesłanki wnioskowania. Chatbot oparty na modelu językowym (np. GPT, Claude) — tak, to system AI.

Czy „zamrożony” model (bez adaptacji po wdrożeniu) podlega AI Act?

Tak. Zdolność adaptacji nie jest warunkiem koniecznym. Nawet model ze stałymi wagami podlega regulacji, jeśli spełnia pozostałe elementy — w szczególności wnioskowanie i wpływ na środowisko.

Czy wytyczne Komisji Europejskiej są prawnie wiążące?

Nie. Wytyczne KE z 6 lutego 2025 r. (sygnatura C(2025) 924 final) zostały formalnie przyjęte przez Komisję, ale nie są prawnie wiążące — autorytatywną wykładnię AI Act może dostarczyć jedynie TSUE. Mimo to stanowią na dziś najpełniejsze źródło interpretacyjne, na którym opiera się praktyka compliance.

Jak wygląda status Digital Omnibus on AI (kwiecień 2026)?

Digital Omnibus (Omnibus VII), zaproponowany przez Komisję Europejską 19 listopada 2025 r., nie został jeszcze formalnie przyjęty. 18 marca 2026 r. komisje IMCO-LIBE PE przyjęły wspólne stanowisko, potwierdzone 26 marca w głosowaniu plenarnym (569 głosów za, 45 przeciw). Rada UE przyjęła mandat negocjacyjny 13 marca 2026 r. Trilog rozpoczął się 26 marca, a kolejna runda zaplanowana jest na 28 kwietnia 2026 r. — ambicją prezydencji cypryjskiej jest porozumienie polityczne do maja 2026 r. Do czasu formalnego przyjęcia 2 sierpnia 2026 r. pozostaje prawnie wiążącą datą.

Nie masz pewności, czy Twoje rozwiązanie to system AI?

Kwalifikacja wymaga analizy specyfiki konkretnego przypadku. Kancelaria KTZR pomaga firmom IT przeprowadzić tę analizę — od wstępnej klasyfikacji po pełny audyt umów wdrożeniowych i compliance z AI Act.

Skontaktuj się z r. pr. Adamem Piotrowskim →Autor: r. pr. Adam Piotrowski, Kancelaria Radców Prawnych KTZR, Gdańsk.

Specjalizacja: prawo nowych technologii, IT, AI. Kontakt: ktzr.pl

Ai act definicja systemu ai

System AI w rozumieniu AI Act (art. 3 pkt 1) – definicja, 7 elementów wg wytycznych Komisji Europejskiej, test kwalifikacyjny. Praktyczne przykłady: co jest, a co nie jest systemem AI.

Zabezpieczenie o zwolnieniu z płatności rat ws. kredytu WIBOR — Postanowienie SO w Gdańsku

Blog Zabezpieczenie o zwolnieniu z płatności rat ws. kredytu WIBOR — Postanowienie SO w Gdańsku Marzec 2026 Zdjęcie: Freepik Sąd Okręgowy w Gdańsku wydał postanowienie o wstrzymaniu spłaty rat kredytu opartego na WIBOR na czas procesu (sygn. XV C 3674/25 z 29.12.2025 r.). To jedno z nielicznych korzystnych rozstrzygnięć dla kredytobiorców w sprawach WIBOR — dlatego warto przeanalizować, czym jest zabezpieczenie roszczenia, jakie daje […]

AI Act – Co Musisz Wiedzieć o Regulacji Sztucznej Inteligencji w UE

Blog AI Act – Co Musisz Wiedzieć o Regulacji Sztucznej Inteligencji w UE W tym artykule dowiesz się: czym jest AI Act i dlaczego obowiązuje bezpośrednio w Polsce, jaki jest harmonogram wdrożenia – kluczowe daty do 2027 r., jakie kategorie ryzyka wprowadza rozporządzenie i co z tego wynika dla Twojej firmy, kto jest dostawcą a […]